Les nouvelles fonctions de sécurité d’IIS 5.0

Microsoft Internet Information Server 5.0 comporte une foule de nouvelles fonctions,

et notamment un traitement amélioré des comptes des utilisateurs et des ordinateurs,

une meilleure exécution des applications des utilisateurs, ainsi que des fonctions

de sécurité perfectionnées.

Etant donné que de nombreux utilisateurs vont commencer à utiliser Windows 2000,

lui aussi porteur d'améliorations majeures en termes de sécurité, et qu'IIS 5.0

est quatre à cinq fois plus rapide qu'IIS 4.0, il était grand temps de consacrer

un article aux nouvelles fonctions de sécurité de la dernière version d'IIS. Celles-ci

facilitent la configuration de la sécurité des applications et, grâce aux nouvelles

technologies comme Kerberos, améliorent la cohérence de l'utilisation de la sécurité

d'IIS avec d'autres systèmes.

L'utilisation d'IIS 5.0 commence par son installation sur Windows 2000. Pour tester

IIS 5.0, j'ai utilisé la beta de Windows 2000 Server. La configuration de Windows

2000 a un impact sur l'utilisation d'IIS 5.0 et sur le fonctionnement des fonctions

de sécurité du logiciel. Le serveur IIS 5.0 peut être configuré comme contrôleur

de domaine ou installé dans un domaine Windows 2000 existant. En d'autres termes

on peut l'installer sur n'importe quelle machine du domaine.

Une fois IIS 5.0 installé, j'ai utilisé Microsoft Visual InterDev 6.0 pour créer

un nouveau répertoire virtuel, tâche que rendent pénible les Extensions FrontPage

Server. Windows 2000 m'a obligé à me connecter par le biais de Visual InterDev

et a vérifié le compte d'utilisateur utilisé par l'OS pour créer le répertoire.

En dehors de mon ID de logon et de mon mot de passe, je n'ai eu besoin d'aucune

information de plus sur Windows 2000. Ce processus correspond à celui d'IIS 4.0

pour créer un répertoire virtuel et travailler avec les fonctions de sécurité.

L'accès aux paramètres de sécurité se fait par le Gestionnaire des services

Internet comme dans IIS 4.0 de Windows NT 4.0

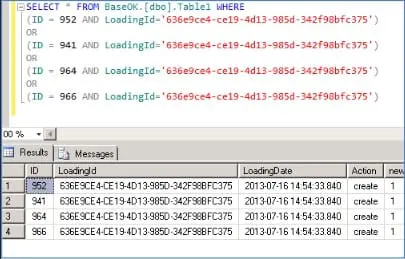

Vues partitionnées distribuées (partie I)

par Kalen Delaney et Itzik Ben-Gan

NDLR : cet article est le premier d'une série de trois sur les Vues partitionnées distribuées de SQL Server 2000.

Les environnements OLTP (OnLine Transaction Processing) et

les bases de données des grands sites Web sont en général constitués de

nombreuses requêtes individuelles, interrogeant ou manipulant une quantité de

données relativement petite. Quand la taille du système augmente, et que les

utilisateurs font de plus en plus de requêtes base de données, les

administrateurs essaient habituellement d'améliorer les temps de réponse en

augmentant la puissance des serveurs. On peut alors ajouter des CPU, remplacer

ses CPU par des CPU plus rapides, ajouter de la mémoire, renforcer le réseau

ou ajouter des disques durs plus rapides, avec de meilleurs contrôleurs. Mais

à un certain moment, on va épuiser les ressources disponibles car les limites

de la machine seront atteintes; à moins que ce ne soit votre budget. SQL Server

2000 apporte une solution à la demande sans cesse grandissante en puissance de

traitement : l'expansion horizontale. Cette solution consiste à fractionner de gigantesques tables

en tables plus petites (chacune étant un sous ensemble, ou partition, de la

table d'origine) et à les faire coexister sur des serveurs distincts. Chaque

serveur peut être géré indépendamment, mais ensemble, ces serveurs forment

une fédération. Pour accéder à une donnée sur n'importe laquelle des

partitions, on définit une vue du même nom sur tous les serveurs, ce qui rend

transparent le fait que les données sont distribuées sur plusieurs noeuds. Un

utilisateur ou une application connectés aux serveurs peut passer des

instructions DML (Data Manipulation Language : langage de manipulation de

données) comme SELECT, INSERT, UPDATE et DELETE sur cette vue comme s'il

interrogeait la table d'origine. SQL Server 2000 intercepte les instructions

et les reroute vers les serveurs appropriés. Cette configuration distribue la

charge de traitement entre tous les membres de la fédération.

Apprenez à utiliser les techniques liées à la stratégie d'expansion horizontale de Microsoft

SQL Server 7.0 permet de créer des vues partitionnées locales. Avec SQL Server 7.0, on peut également créer des vues partitionnées sur de multiples serveurs, mais on ne peut pas les modifier, ce qui limite beaucoup leur utilité. De plus, avec SQL Server 7.0 ainsi que les versions précédentes, toute vue basée sur une opération UNION ne peut être mise à jour, qu'elle se trouve sur un serveur unique ou soit distribuée sur de multiples serveurs. SQL Server 2000 remédie à cette restriction en permettant aux utilisateurs de mettre à jour certains types de vues basée sur la commande UNION, et introduit de nouvelles techniques d'optimisation pour la mise en place des vues partitionnées. Nous allons présenter ces nouvelles techniques d'optimisation dans cet article, et vous montrer comment mettre en place et modifier des vues partitionnées distribuées.

Lire l'article

Colorisez SEU !

par Brian Stapleton

Ajoutez de la couleur à vos sources RPG/400 et RPGIV avec les utilitaires COLORRPG

et COLORILE

Avez-vous déjà vécu l'une de ces journées où cinq minutes avant la fermeture des

bureaux, vous vous entendez dire qu'à cause d'une erreur de programme, un de vos

collègues a scanné 15 000 boîtes en erreur ? Ou bien que le service comptabilité

a découvert une erreur dans le grand livre, et attend jusqu'au moment où les rapports

de fin de mois doivent être imprimés pour vous en informer ? Pour ma part, au

cours de telles journées, tandis que le patron fait les 100 pas devant mon bureau,

que ma tête me fait affreusement mal et que ma boîte de paracétamol est vide,

j'ai l'impression que les lignes de code se brouillent et que l'écran SEU devient

illisible.

Aussi, pour soulager mes yeux et rendre les sources RPG/400 et RPG IV plus lisibles,

j'ai créé deux utilitaires, COLORRPG et COLORILE, qui ajoutent de la couleur aux

sources affichés avec SEU. Ces outils sont faciles à utiliser et à modifier.

Le coeur de ces utilitaires est les programmes RPG/400 COLORRPGR et RPG IV COLORILE.

Dans le présent article, je traite de la version RPG IV. Même si la version RPG/400

est un peu plus simple, elle fonctionne de façon identique. (Vous trouverez le

code intégral de ces utilitaires, soit trois programmes pour la version RPG IV

et trois pour la version RPG/400, à l'adresse http://www.newsmag.com).

Pour soulager mes yeux et rendre les sources RPG/400 et RPG IV plus lisibles,

j'ai créé ces deux utilitaires

Gros plan sur les passerelles SNA

Explorons les dernières versions de eNetwork Communications Server for Windows

NT et SNA Server

Au cours des quatre années qui se sont écoulées depuis la sortie de la V3R1, époque

où IBM a implanté TCP/IP sur sa plate-forme, le protocole a connu une évolution

spectaculaire, passant d'un produit réseau accessoire à un composant incontournable.

Si vous souhaitez utiliser votre AS/400 comme serveur Web, tirer profit du support

natif de Domino sur AS/400, ou utiliser votre AS/400 comme serveur de messagerie,

vous avez besoin de TCP/IP.

Mais il se trouve que de nombreuses entreprises opèrent dans un environnement

réseau hétérogène, où TCP/IP doit coexister avec SNA, IPX/SPX, et bien d'autres

protocoles encore. L'une des raisons qui poussent les sites AS/400 à conserver

SNA dans leur environnement peut être ses performances et ses API. IBM jouit d'une

plus longue expérience dans l'optimisation des performances SNA que dans celle

de TCP/IP.

Aussi, il y a deux ans, les tests effectués par Microsoft semblaient indiquer

que les connexions de PC à AS/400 étaient plus performantes avec SNA qu'avec TCP/IP,

quoique IBM conteste ces résultats.

Les passerelles SNA ont fait leurs preuves pour les sites SNA qui ont

par ailleurs besoin de se connecter à un réseau TCP/IP

Les passerelles SNA ont fait leurs preuves pour les sites qui souhaitent

utiliser SNA sur leurs AS/400, mais qui par ailleurs ont toujours besoin de se

connecter à un réseau TCP/IP. Une passerelle SNA utilise un serveur PC pour convertir

un protocole réseau local comme TCP/IP, IPX, ou NetBEUI/NetBIOS en SNA, et acheminer

les trames de et vers un AS/400 ou un gros système IBM. Deux des principaux acteurs

(mis il y en a d'autres) de ce marché des passerelles SNA sur AS/400 sont eNetwork

Communications Server for Windows NT d'IBM et SNA Server de Microsoft.

Tous deux permettent de connecter un AS/400 à un réseau local TCP/IP à l'aide

de clients Windows NT/95/3.1 ou OS/2. Dans un premier temps, nous examinerons

le fonctionnement général des passerelles SNA. Ensuite, nous verrons comment configurer

eNetwork Communications Server puis SNA Server pour connecter un AS/400 à un réseau

local TCP/IP.

Windows et les évolutions d’interface

Comment Microsoft décide-t-il de l'opportunité des changements de comportement

de l'interface de ses produits ? L'éditeur affirme rechercher une facilité d'utilisation

accrue. On peut parfois douter du bon sens de Microsoft.

Un certain nombre de modifications de l'interface utilisateur ont commencé à faire

leur apparition dès les premières versions de Microsoft Internet Explorer 4.0,

avec un nouveau comportement installé par défaut : la commande d'action par clic

de souris unique. Les versions béta ultérieures et la version finale d'IE 4.0

le proposaient en option, mais retournaient, par défaut, au double clic antérieur.

La principale explication de cette modification de l'interface et du comportement

des produits Windows au cours de leurs derniers stades d'évolution, serait, à

en croire Microsoft, la facilité d'utilisation. L'éditeur affirme que, selon des

tests approfondis, les changements apportés à Windows NT 4.0 et Windows 9x facilitent

l'apprentissage et l'utilisation des produits.

Certes, ces changements ont sans doute amélioré l'" utilisabilité " de Windows,

mais beaucoup de modifications d'interface paraissent tout à fait gratuites. Y

avait-il beaucoup d'utilisateurs tambourinant à la porte de Microsoft en réclamant

des couleurs dégradées pour les barres de titre et la possibilité, pour les menus,

de s'étendre et de se contracter, au lieu d'apparaître simplement ?

Générer automatiquement des rapports de déploiement

De nombreuses grandes entreprises passent beaucoup de temps à écrire des scripts

et programmes pour générer automatiquement des rapports sur leurs bases de données.

Certaines écrivent leurs programmes en Visual Basic ou Visual C++ ; certaines

utilisent des applications comme Excel, Access ou Visual Basic for Applications

; et les autres utilisent d'autres méthodes. Avec Active Directory, les choses

changent.

Avec l'arrivée de Windows 2000 et d'Active Directory, il peut devenir intéressant

d'apprendre comment utiliser de simples scripts pour utiliser Excel 2000 en mode

automatique afin qu'il génère des rapports. Ces scripts peuvent en effet désormais

bénéficier d'ADSI (Active Directory Services Interface) pour interroger AD. L'exemple

qui suit devrait vous en faire prendre conscience.

Imaginons une entreprise dans laquelle un utilisateur désire installer Windows

2000 sur un client. L'utilisateur doit utiliser un système maison avec un frontal

Web pour créer le compte machine du client. L'utilisateur devra entrer son profil

et les détails de la machine. Les neuf détails de la machine sont : l'adresse

MAC (Media Access Control) de la carte réseau ; le nom de l'installateur de la

machine ; le département, le bâtiment, l'étage et le bureau ; et le nom, numéro

de téléphone et l'adresse e-mail de la personne qui connaît le mot de passe d'administrateur

de la machine. L'utilisateur peut également spécifier un nom qu'il souhaite utiliser

pour la machine. Lorsque l'utilisateur envoie le formulaire Web, le système lance

une série de procédures de vérifications contrôlant les détails de l'utilisateur

et de la machine. Ensuite, le système affecte un nom à la machine. Le système

peut accepter le nom fournit par l'utilisateur, si tel est le cas, ou il peut

en créer un. Ensuite, le système Web renvoie le nom résultant à l'utilisateur

et lui demande s'il accepte ce nom. Si le nom est accepté par l'utilisateur, le

système Web crée un objet de compte utilisateur dans AD. Si l'utilisateur n'accepte

pas le nom, le formulaire réapparaît avec les données d'origine inchangées et

un processus de négociation s'engage, le système suggérant une liste de noms ou

l'utilisateur en proposant.

L'ensemble du processus de la saisie des données à la réception et l'accord sur

le nom ne prend que quelques instants. Une fois ce processus effectué, l'utilisateur

peut utiliser le compte d'ordinateur créé dans AD pour installer Windows 2000

sur le client. Le système Web fournit très facilement les 9 détails de la machine

comme données pour les neuf attributs étendus du compte de l'ordinateur dans AD.

On peut utiliser un script tel que celui du listing 1 pour afficher les attributs

du système dans la boîte de message de l'écran 1.

Windows NT et VMS : de proches cousins

Lors du lancement de la première version de Windows NT par Microsoft, en avril 1993, Microsoft a lourdement insisté sur le sigle " NT " (pour Nouvelle Technologie) du nom de l'OS. L'éditeur a présenté NT comme un système d'exploitation très en pointe, offrant toutes les caractéristiques que pouvaient attendre les utilisateurs d'un OS destiné aux stations de travail et aux serveurs de petite ou de moyenne taille. Windows NT était certes un nouveau système d'exploitation en 1993, avec une nouvelle API (Win32) et de nouveaux outils d'administration, mais les racines de l'architecture de base et l'implémentation de Windows NT remontent en fait au milieu des années soixante-dix. Partir à la découverte des racines profondes de Windows NT mène rapidement à Digital et à son système d'exploitation VMS. Les principaux développeurs de Windows NT, dont son architecte en chef David Cutler, sont pour la plupart issus de Digital et leur passé a nettement joué sur le développement de l'OS. Après une rapide évocation de l'histoire de Windows NT, nous verrons les similitudes, loin d'être de pures coïncidences, entre Windows NT et VMS, ainsi que la réaction de Digital lors de la sortie du nouvel OS.

Lire l'article

Métadonnées : le trésor caché de la base de données AS/400

Voici comment extraire les informations de votre base de données AS/400 et à les utiliser dans vos applications Les entrailles de l'AS/400 contiennent une mine

d'informations sur chaque fichier présent dans le système. En utilisant ces

informations (appelées métadonnées) on peut découvrir le contenu détaillé

de ces fichiers base de données. Les métadonnées sont "des données décrivant

des données" : elles décrivent une base de données depuis ses noms

de fichiers jusqu'aux codes de modification des champs numériques. Aussi ésotériques

que puissent paraître les métadonnées, on compte sur elles chaque jour sans

s'en rendre compte. Ainsi, le compilateur RPG IV utilise des métadonnées

pour lier les fichiers décrits en externe aux programmes. Et la commande WRKQRY

(Work with Queries) et le programme SQL interactif affichent des métadonnées

qui serviront à construire des requêtes. Les métadonnées sont indispensables

aux utilitaires d'analyse d'impact sur les bases de données et de

traitement de fichiers. De plus, leur compréhension permet d'écrire des

applications de bases de données souples en Java. Voyons de plus près comment

découvrir ce trésor caché, de quelles métadonnées dispose l'AS/400 et

comment les utiliser efficacement.

Voyons de quelles métadonnées

dispose l'AS/400 et comment les utiliser efficacement

Sécuriser et partager les données dans les environnements mixtes NT/Unix.

Avec la popularité grandissante de Windows NT, la coexistence avec Unix devient

quasi systématique, même parmi les entreprises ayant fait le choix d'Unix. Un

problème majeur demeure : le partage des données que les deux systèmes d'exploitation

gèrent très différemment.

Supposons que vous soyez administrateur système Unix dans une grande entreprise

et que votre direction informatique décide de standardiser tous les postes de

travail clients du réseau sous Windows NT Workstation 4.0. Naturellement les nouveaux

utilisateurs de NT vont devoir accéder à leurs fichiers Unix à partir du nouveau

système NT. Quels sont les options à votre disposition pour résoudre ce problème

pour un coût raisonnable ? Les options sont malheureusement très limitées. Unix

et NT sont issus de deux origines distinctes et comme leurs contextes sont différents,

chacun des deux systèmes d'exploitation a sa propre logique pour stocker et partager

les fichiers.Mais tout n'est pas si noir.

En raison de la popularité grandissante de NT dans les entreprises, plusieurs

méthodes ont vu le jour pour faciliter le partage des fichiers entre NT et Unix.

Elles permettent de mettre en place un accès non interactif, au moyen de programmes

Microsoft comme FTP ou HyperTerminal, ou l'accès interactif, grâce à des outils

faisant appel au standard CIFS ou au protocole de transmission NFS.

Migrer de Domino R4 en R5

par Ben Malekzadeh

Bien que Lotus Domino Version 5 (R5) soit disponible depuis un an environ, de

nombreux sites Domino n'envisagent que maintenant de faire une mise à niveau

Une fois le cap de l'an 2000 passé, votre entreprise souhaite peut-être migrer

en R5 pour bénéficier des nombreuses nouvelles fonctionnalités de cette version,

ou pour résoudre des problèmes qui empoisonnent depuis longtemps les anciennes

versions Domino. Peut-être aussi pour profiter des améliorations de la R5 en matière

de Web.

En tout cas, il faut une raison valable : pas question de consacrer énormément

de temps, d'effort et d'argent à une migration qui ne serait pas absolument nécessaire.

Etudiez vos besoins et analysez soigneusement les coûts avant d'entamer une migration

R5.

Je propose ici quelques conseils pour passer en douceur de la R4 à la R5, en insistant

tout particulièrement sur la manière de préparer l'infrastructure Domino existante

avant de recevoir la R5. Ces conseils valent pour toute plate-forme Domino, y

compris Domino pour AS/400.

Instaurer des stratégies système NT

Beaucoup d'appels au help desk proviennent d'utilisateurs essayant de configurer leurs systèmes. Pour tenter d'éviter ces appels, vous pouvez limiter les possibilités des utilisateurs de modifier leur configuration. En fixant des limites aux modifications que les utilisateurs peuvent apporter à la configuration de leur PC, vous pouvez éviter bien des interventions et renforcer la sécurité de votre réseau. Vous pourriez même obtenir des gains de productivité importants si vos utilisateurs ne peuvent exécuter que certains programmes. Autant de bonnes raisons de jeter un coup d'oeil aux stratégies système de Windows NT et à l'outil qui sert à les créer : l'Editeur de stratégies système (ESS). Sachez qu'il est possible de profiter aussi de stratégies semblables pour vos clients Windows 9.x.

Lire l'article

Partager des fichiers avec NFS

NFS (Network File System) permet à l'AS/400 d'accéder à une activité d'import/export de fichiers

A chaque release de l'OS/400, IBM ajoute de nouvelles fonctions

TCP/IP, rendant du même coup l'AS/400 plus ouvert et plus adapté aux réseaux,

au fur et à mesure qu'il mûrit. Nous avons récemment assisté à l'addition de

services IP comme DNS (Domain Name System : système de noms de domaines) et

DHCP (Dynamic Host Control Protocol : protocole dynamique de contrôle d'hôtes)

mais aussi à celle de SMB (Server Message Block) qui permet à l'AS/400 de partager

le système de fichiers et les ressources d'impression de la même manière que

Windows NT.

Le partage des fichiers de NetServer avec SMB fonctionne bien pour des clients

Windows 95/98/NT. Mais qu'en est-il si les applications AS/400 doivent accéder

aux données d'un PC ? L'AS/400 peut être un serveur SMB, mais pas un client.

Autre cas : qu'en est-il si on a besoin de partager les fichiers avec de nombreuses

plates-formes hétérogènes, telles que plusieurs Unix, et que l'on ne souhaite

pas transférer les fichiers par FTP sur chaque système ? Entrez donc dans NFS

(Network File System).

Sun a sorti la version 1 de NFS en 1984 comme la solution au partage des fichiers sur des ordinateurs Unix en réseau

Lire l'article

Quitter la fraternité de l’anneau

Voici quelques indications pour réussir votre voyage de Token Ring vers une nouvelle

vie avec Ethernet haute vitesse

Bilbo Baggins, le hobbit héros de la trilogie Le

Seigneur des anneaux de J.R.R. Tolkien, entama un difficile voyage de son

pays natal vers un royaume étranger où l'attendaient de terribles batailles. Il

quitta un pays doux et confortable, parce qu'il le fallait - le monde extérieur

avait changé, et des nouveautés s'annonçaient. Il était membre de la Fraternité

de l'anneau, un groupe de camarades itinérants poursuivant une cause commune.

Mais les événements du monde rendirent inévitable la fin de la fraternité. Bilbo

espérait qu'en fin de compte, le bien triompherait du mal et que le monde deviendrait

un endroit meilleur.

En tant qu'administrateur de réseau Token-Ring (anneau à jeton), vous êtes membre

d'une semblable fraternité. Comme Bilbo, un long voyage vous attend: un voyage

qui vous entraînera hors de la Fraternité du Token-Ring. Heureusement, vous pouvez

en voir la fin. Vous savez que les batailles des réseaux à haut débit ont déjà

été livrées, que le bien a triomphé, et qu'un monde meilleur vous attend. Mais

nombreuses sont les routes qui mènent au Pays d'Ethernet. Vous devez savoir laquelle

prendre et comment l'emprunter.

Peu de gens doutent sérieusement de la disparition de Token-Ring; IBM elle-même

semble constituer le dernier carré des fidèles à Token-Ring, mais Big Blue s'est

couvert en déployant une gamme complète de produits Ethernet. Le marché a parlé:

le monde appartient à Ethernet. Non seulement ce dernier est plus rapide - on

trouve actuellement des produits à 1 Gbps, tandis que le Token Ring à 100 Mbps

apparaît à peine (voir l'encadré "Token-Ring haute vitesse: trop petit, trop bancal"),

mais pratiquement tous les composants réseau (firewalls, cartes interface réseau

(NIC, network interface cards), routeurs), en ont besoin. Seule une petite frange

du marché LAN s'intéresse encore à Token-Ring.

De par le passé, les voies de migration favorites des utilisateurs Token-Ring

étaient FDDI (Fiber Distributed Data Interchange) à 100 Mbps ou ATM (Asynchronous Transfer Mode) à 155 Mbps. L'arrivée du Gigabit

Ethernet bon marché a modifié tout cela. FDDI, avec ses 100 Mbps, est tout simplement

trop lent, et même si ATM atteint 620 Mbps, ses composants sont coûteux et complexes

par rapport à 1000BaseTF de l'Ethernet à 1 Gigabit. Donc, à moins d'avoir déjà

investi dans FDDI ou ATM, il vaut mieux passer carrément en 100 Mbps et à Ethernet

à 1 Gigabit.

Il n'y a donc plus de doute: il est temps de changer. Mais comment passer de Token-Ring

à Ethernet sans dépenser une fortune en nouveau câblage et en matériel, sans perdre

des centaines d'heures à réinstaller les NIC et à reconfigurer les systèmes, et

pourquoi encourir le reproche d'avoir initialement choisi Token-Ring pour son

LAN?

La réponse est la même que celle que Gandalf le sorcier a faite à Bilbo lorsque

celui-ci lui a demandé comment commencer son voyage: "Un pas à la fois". En apprenant

les aspects techniques de la migration, où commencer le déploiement d'Ethernet,

comment le faire rentablement, et comment obtenir d'autres avantages en même temps,

on peut migrer vers Ethernet à moindre coût et avec peu de perturbations.

Au lieu de perdre la face, vous gagnerez en crédibilité car votre réseau sera

plus rapide et plus fiable.

Gandalf le sorcier, lorsque Bilbo

lui a demandé comment commencer son voyage, a répondu: "Un pas à la fois".

Une exploration de Client Access Express

Express simplifie considérablement l'installation et la configuration de Client

Access. Voici comment !

Client Access Express guérit les principaux maux dont souffrait Client Access

pour Windows 95/NT. L'ancien Client Access s'appropriait le PC client et consommait

une grande partie de ses ressources mémoire et disque pour, somme toute, un simple

morceau de logiciel de connectivité. L'installation de Client Access pour Windows

95/NT demandait également la présence de services d'arrière-plan pour tout prendre

en charge, depuis l'accès au réseau AS/400 jusqu'aux commandes à distance en entrée.

De plus, le produit ne permettait pas aux utilisateurs de supprimer facilement

les parties indésirables. Et le support SNA de Client Access pour Windows 95/NT

n'était pas irréprochable. Le système se bloquait souvent, ou les PC étaient immobilisés

pendant le démarrage ou la fermeture. Même après plusieurs années de développement

et de corrections, le produit n'a jamais totalement satisfait de nombreux utilisateurs.

Client Access Express résout les problèmes grâce à un ensemble de fonctionnalités

qui se concentrent sur l'essentiel de la connectivité PC-AS/400

Client Access Express résout ces problèmes grâce à un ensemble de fonctionnalités

qui se concentrent sur l'essentiel de la connectivité PC-AS/400. Comme son prédécesseur

Client Access pour Windows 95/NT, le nouveau client Express s'exécute sur des

systèmes Windows 9x et NT. Express a supprimé une bonne partie du support

devenu obsolète de Client Access pour Windows 95/NT et donne aux utilisateurs

une plus grande maîtrise de l'exécution des processus d'arrière-plan. En outre,

Express utilise les possibilités des services de fichiers et d'impression natifs

de l'AS/400, via AS/400 NetServer.

Cela permet à un PC Client Access d'utiliser “ Windows Neighborhood Network ”

pour se connecter à l'AS/400 et aussi de se passer des daemons et des tâches d'arrière-plan

qu'utilisait Client Access pour Windows 95/NT. Le client Express résout les problèmes

SNA en abandonnant la connectivité et le support SNA des applications 16 bits.

Comme la plupart des connexions TCP/IP actuelles, ces modifications permettent

à Client Access Express de mieux répondre aux besoins de connectivité de l'AS/400.

Voyons les étapes de base nécessaires pour installer et configurer Client Access

Express.

Centraliser l’administration avec les stratégies de groupe

Les stratégies de groupe, ou group policies, sont la nouvelle fonction de Windows 2000 que je préfère. Elles permettent une chose qui n'existait pas dans Windows NT : le contrôle centralisé, mais granulaire, des ordinateurs des utilisateurs. On pourrait en quelque sorte comparer les stratégies de groupe à des stratégies système NT 4.0 qui seraient arrivées à maturité. Les Group Policy Objects (GPO), ou Objets de stratégie de groupe, sont des objets Active Directory (AD) permettant une configuration centralisée des ordinateurs et des serveurs Windows 2000. Les fonctionnalités des stratégies de groupe englobent tout, du verrouillage des PC à la mode NT 4.0 jusqu'à la configuration de la sécurité et l'installation des logiciels.Cet article explique comment fonctionnent les stratégies de groupe, ce qui se passe à l'intérieur du système et comment traiter un certain nombre de défis à relever, avant de procéder au déploiement de cette technologie dans un environnement Windows 2000. Sachez enfin que pour bien comprendre la stratégie de groupe, il vaut mieux connaître le mode de fonctionnement des stratégies système de NT 4.0.

Lire l'article

Le blues du double boot

Lorsque Steve Balmer, Président de Microsoft, a annoncé la disponibilité de Windows 2000 Professional, il a qualifié l'OS de "meilleur système d'exploitation pour les utilisateurs d'entreprise", point ! A bien des égards, cette assertion est vraie, mais l'OS n'est pas entièrement compatible avec les matériels et logiciels pour Windows 9x. Le double boot est donc souvent une nécessité.J'attends toujours un driver de scanner/fax afin de pouvoir exploiter mon imprimante HP OfficeJet 710 sous Windows 2000 et j'utilise des logiciels de simulation de vol qui ne tournent pas sous Windows 2000. Je ne peux donc pas supprimer Windows 98, quelle que soit mon envie de le faire et, à en juger par le courrier que je reçois, je ne suis pas le seul dans ce cas. Il est donc plus que possible que vous souhaitiez savoir comment créer un environnement à double initialisation qui permette de passer de Windows 2000 à Windows 98.

Lire l'article

Comment intégrer Windows NT dans un environnement Unix

Les serveurs Windows NT empiètent de plus en plus sur les environnements UNIX.

Or, ni l'un ni l'autre des deux OS ne convient à toutes les situations. Les tenants

de Windows NT et d'UNIX préfèrent généralement que les réseaux se limitent à leur

solution respective, mais beaucoup de fournisseurs (dont Microsoft, HP, Compaq

et SCO) ont adopté des programmes d'interopérabilité agressifs.

Au final, la plupart des entreprises exploitent à la fois NT et UNIX, car chacun

des OS offre des fonctionnalités propres.

Avant de prendre la décision d'intégrer Windows NT dans une entreprise fortement

engagée dans UNIX, il convient de répondre à quelques questions fondamentales.

Commencez par cerner quels sont les facteurs qui vous incitent à ajouter NT à

votre réseau.

Avez-vous des raisons techniques ou professionnelles pressantes, ou bien suivez-vous

simplement la tendance du secteur ?

Etudiez ensuite le coût des matériels et logiciels qu'exigerait un réseau mixte

sur une période de cinq ans.

Troisièmement, pensez aux coûts cachés d'une telle intégration, y compris son

effet sur les utilisateurs de votre réseau (par exemple la formation, le temps

d'arrêt potentiel, la résistance au changement…).

Quatrièmement, assurez-vous que les applications sous Windows NT peuvent répondre

aux exigences de votre organisation. Cinquièmement, déterminez si les avantages

qui en découlent l'emportent sur le coût occasionné par l'intégration des deux

OS.Pour associer NT et UNIX dans un réseau, il faut mettre sur pied un projet

d'intégration adapté aux besoins de l'entreprise. Les administrateurs systèmes

qui en sont chargés risquent facilement d'être submergés. Il n'est malheureusement

pas possible d'utiliser de schéma clair pour mixer les deux OS. Il n'existe aucune

solution convenant à toutes les entreprises.

Quoi de neuf dans le SP6a ?

Beaucoup d'utilisateurs ont installé le SP6, puis l'ont supprimé quelques jours plus tard soit en raison de la mauvaise publicité, soit à cause des problèmes découverts pendant les tests. C'est pourquoi beaucoup de serveurs NT 4.0 exécutent toujours le SP5 et les utilisateurs sont nombreux à se poser des questions sur les SP6 et SP6a. Le moment est-il venu pour eux de mettre à niveau les systèmes SP5 ? Microsoft a sorti le Service Pack 6 (SP6) pour le téléchargement public à la fin d'octobre 1999. Dès la première semaine, plusieurs problèmes ennuyeux ont été signalés - une erreur Winsock qui a notamment empêché les utilisateurs d'accéder à Lotus Notes sauf s'ils étaient connectés avec des droits d'administrateurs ; une erreur Appletalk qui a généré un écran bleu sur des systèmes connectés à un serveur de réseau Appletalk ou à un serveur d'impression Apple ; et un problème de date dans le convertisseur de journaux de Microsoft Internet Information Server (IIS) 3.0 qui a converti les années 2000 en 2028. Microsoft a corrigé ces problèmes dans le SP6a, y compris une mise à jour de winver.exe (l'utilitaire de ligne de commande qui indique la version de l'OS en cours d'exécution) et a sorti le nouveau service pack à la fin de novembre 1999. Le SP6a remplace et annule le SP6 et tous les service packs antérieurs. Alors, le moment est-il venu de mettre à niveau les systèmes SP5 ? Les explications de cet article sur les correctifs du SP6a devraient apporter suffisamment d'informations techniques pour en décider.

Lire l'article

Windows NT et la duplication

Le processus de duplication de Windows NT permet de maintenir synchronisées deux

structures de répertoires, que ce soit sur le même ordinateur ou entre ordinateurs.

Son principal objectif est de garantir que le système copie les scripts de connexion

du PDC sur les BDC.

On peut utiliser la duplication à d'autres fins que la synchronisation des contrôleurs

secondaires de domaine (BDC pour Backup Domain Controllers). Elle permet la distribution

de données en lecture seule (par exemple une liste des téléphones d'une entreprise

ou des fichiers contenant des informations sur la société) à partir d'un serveur

central.

Cependant, elle n'est pas particulièrement indiquée pour ces tâches. Il existe

de meilleures techniques pour distribuer les données.La duplication paraît simple,

mais occasionne un certain nombre de problèmes. Cet article détaille son fonctionnement,

quand l'utiliser et comment la configurer.

Les plus consultés sur iTPro.fr

- Temps d’arrêt IT : un coût de 600 milliards de dollars pour les entreprises du Global 2000

- Microsoft Build 2026 : contre-offensive des modèles maison face à OpenAI et Anthropic

- L’anxiété liée à l’IA, un risque sous-estimé pour la sécurité

- IA générative en Europe : une adoption massive, mais une gouvernance toujours en retard

Articles les + lus

Computex 2026 : 5 signaux forts à retenir

La chaîne d’approvisionnement, point de rupture récurent du SI

Microsoft Build 2026 : contre-offensive des modèles maison face à OpenAI et Anthropic

Rhea1 : SiPearl allume le CPU européen le plus ambitieux pour le HPC et l’IA souveraine

Analyse Patch Tuesday Mai 2026

À la une de la chaîne Tech

- Computex 2026 : 5 signaux forts à retenir

- La chaîne d’approvisionnement, point de rupture récurent du SI

- Microsoft Build 2026 : contre-offensive des modèles maison face à OpenAI et Anthropic

- Rhea1 : SiPearl allume le CPU européen le plus ambitieux pour le HPC et l’IA souveraine

- Analyse Patch Tuesday Mai 2026