En 2025, ces arnaques explosent dans le monde et la France n’est pas épargnée. Les deepfakes deviennent un outil économique de fraude de masse.

Alerte sur les escroqueries reposant sur les deepfakes

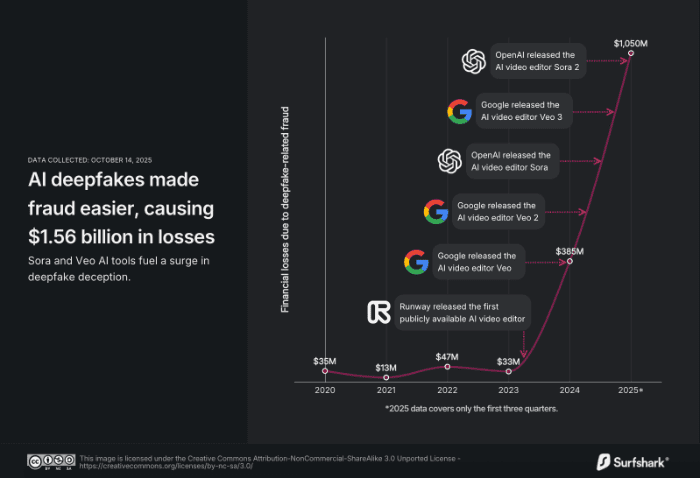

Les escroqueries reposant sur les deepfakes (images, voix, vidéos générées par IA) augmentent selon l’étude Surfshark. Les pertes financières dépassent désormais 1,56 milliard de dollars, soit près de 1,34 milliard d’euros. En 2025, plus d’un milliard de dollars se sont volatilisés à cause de ces fraudes.

Deepfakes, des escroqueries simples et rentables

Ces escroqueries ne font que progresser. En 2019-2023, on note 130 millions $ de pertes cumulées. En 2024 : 400 millions $ et en 2025, déjà 1 milliard $. En six ans, les pertes ont donc été multipliées par 12.

Aujourd’hui, grâce à des outils d’IA grand public (Sora ou Veo), une vidéo deepfake peut être générée pour quelques euros. Les escroqueries sont plus simples, plus rapides et plus rentables.

Des scénarios émotionnels

De nouveaux scénarios émotionnels prennent place : images générées de chiens ou chats perdu , envoyées aux propriétaires avec une demande de 50 € de frais de restitution, vidéos truquées d’employés ou de dirigeants demandant un virement urgent, entretiens d’embauche falsifiés. « Le coût de la tromperie est désormais proche de zéro », alerte Maud Fraison Lepetit, Responsable France chez Surfshark. « Ce n’est plus une fraude isolée, c’est une industrialisation de la manipulation. »

Comment renforcer son scepticisme numérique ?

Voici quelques recommandations à mettre en place pour se prémunir

- Vérifier systématiquement !

toute demande d’argent ou d’information par un canal connu (appel direct, confirmation interne)

- Prendre son temps

La précipitation est l’arme des escrocs

- Former les équipes sensibles : finance, RH, communication

Pour reconnaître les signaux d’un deepfake (voix trop “parfaite”, micro-décalage des lèvres, incohérences visuelles)

- Renforcer les procédures multi-niveaux

avant toute transaction ou embauche.

Source : Etude Surfshark – Surfshark Research – “AI Deepfake Losses”

Pour compléter votre information sur les fraudes et les deepfakes avec iTPro.fr :

Téléchargez cette ressource

Guide de Threat Intelligence contextuelle

Ce guide facilitera l’adoption d’une Threat Intelligence - renseignement sur les cybermenaces, cyberintelligence - adaptée au "contexte", il fournit des indicateurs de performance clés (KPI) pour progresser d' une posture défensive vers une approche centrée sur l’anticipation stratégique

Les articles les plus consultés

- Envahissement de l’Ukraine par la Russie : la cybersécurité en deuxième ligne, les SOC en alerte maximale

- Cybercriminalité : des attaques de plus en plus sophistiquées

- Les 6 recommandations pour les RSSI

- Cybersécurité : Techniques de cartographie Active Directory avec BloodHound

- Cybersécurité : comment évaluer sa cyber maturité !

Les plus consultés sur iTPro.fr

- Communication d’entreprise à l’ère de l’IA : fragmentation, Shadow AI et perte de contrôle

- Pourquoi les outils de sécurité ne suffisent plus face aux angles morts de la détection

- Rhea1 : SiPearl allume le CPU européen le plus ambitieux pour le HPC et l’IA souveraine

- L’analytique prédictive au service de la décarbonation en France

Articles les + lus

Pourquoi les outils de sécurité ne suffisent plus face aux angles morts de la détection

Explosion des identités et insécurité persistante : l’EMEA face à un tournant critique

ALERTE ! De nouvelles générations de cybermenaces dopées à l’IA

Mythos révèle les limites d’un Zero Trust centré sur le réseau

Splunk : vers un SOC agentique et de confiance

À la une de la chaîne Sécurité

- Pourquoi les outils de sécurité ne suffisent plus face aux angles morts de la détection

- Explosion des identités et insécurité persistante : l’EMEA face à un tournant critique

- ALERTE ! De nouvelles générations de cybermenaces dopées à l’IA

- Mythos révèle les limites d’un Zero Trust centré sur le réseau

- Splunk : vers un SOC agentique et de confiance